Règlementation DORA et établissements financiers : comment s’y préparer ?

Temps de lecture estimé : 14 minRédaction WEB : JUST DEEP CONTENT

Le 27 novembre 2021, le Groupe Adélaïde (Groupe comprenant notamment le courtier Génération) était victime d’une attaque ransomware, rendant certains de ses services essentiels inopérants pendant plusieurs jours.

Plus récemment, les données personnelles de 50 000 clients de la banque en ligne Revolut ont été exposées à la suite d’une attaque cyber opérée le 11 septembre 2022.

Adresses électroniques, noms complets, codes postaux et numéros de téléphone, ce sont tout autant de données exposant ainsi ces clients à de potentiels futurs préjudices notamment l’usurpation d’identité.

Ces attaques ne sont qu’un extrait de la pléthore de tentatives constatées dans le monde, et dont le nombre croît chaque jour.

Le rapport « RISK2030 : Cartographie des Risques et des Opportunités des entreprises françaises à l’Horizon 2030 » confirme cela en considérant dans son « podium des risques » que la cyber-malveillance est au premier rang. Ces risques cyber, touchant les Systèmes d’Information (SI) de tout type d’entreprise, pourraient avoir un impact important sur la résilience des banques et la stabilité financière. Que se passerait-il si, tout comme pour la mutuelle Génération, la plupart des services d’une grande banque internationale était inopérant pendant un laps de temps prolongé ? C’est à ce titre que les régulateurs bancaires catégorisent aujourd’hui les risques cyber comme un risque systémique.

C’est un point que LesEchos fin 2018 notifiait déjà à travers cette citation :

« Aux yeux des gendarmes financiers, les hackers pourraient représenter un danger aussi important pour la stabilité financière que les « Subprimes » il y a dix ans ».

C’est dans ce contexte que la France considère que les Grandes Banques Françaises dites systémiques sont des Opérateurs d’Importance Vitale (OIV) au sens de la loi de Programmation Militaire. Elles sont dans ce cadre assujetties à une obligation renforcée de protection de leur Système d’Information à Importance Vitale (SIIV) contre les risques cyber.

Cette obligation a d’ores et déjà commencé à les préparer au renforcement réglementaire qui s’ensuit aujourd’hui avec l’avènement de plus en plus prégnant du risque cyber.

Car le ton est au renforcement sur le sujet de la cyber résilience, et cela s’est traduit en septembre 2020 par la publication par la Commission Européenne d’un Projet de Loi sur la Résilience Opérationnelle Digitale, ou le « Digital Operational Resilience Act (DORA) ».

DORA est une réglementation à venir permettant d’adresser les risques liés aux Technologies de l’Information et de la Communication (TIC), terme assez large regroupant l’ensemble des outils, services et techniques permettant la création et le traitement (collecte, enregistrement, transmission …) des informations via différents canaux : l’informatique en général, Internet, la radio-télévision et les télécommunications.

Quand il est fait référence à ces technologies, il s’agit également de nouvelles technologies liées à l’information et la communication (NTIC) regroupant les outils à la croisée de l’informatique, la télécommunication et l’audiovisuel tels que les smartphones, ou encore le Cloud. C’est donc un terme assez large qui a pour but de regrouper la gestion de l’ensemble des risques liés au digital.

Que faut-il entendre par gestion des risques liés au digital ? Que demande la réglementation ?

Le projet peut être grossièrement divisé en quatre piliers principaux :

- Renforcement de la gestion des risques TIC (engagement du conseil d’administration, homogénéisation du dispositif de gestion des risques …)

- Reporting des incidents (attentes supplémentaires du régulateur, homogénéisation des signalements des incidents …)

- Tests de résilience (renforcement des capacités de tests et/ou sous-traitance à un organisme tiers pour effectuer des tests de résilience et d’intrusion …)

- Evaluation des risques des prestataires TIC (réviser les accords contractuels avec ces tiers, mise à jour de la stratégie de sortie de ces derniers …)

DORA s’adresse à qui ?

Cette réglementation sera applicable à toutes les entités financières réglementées par la Commission Européenne, et, seront aussi dans le périmètre toute institution ayant des opérations en Union Européenne.

Les prestataires de TIC considérés comme « critiques » tomberont aussi dans l’escarcelle du règlement DORA, fait peu commun dans le cadre des précédents projets de loi touchant principalement les acteurs financiers.

Quand le règlement DORA commence-t-il à s’appliquer ?

Pas d’annonce officielle pour le moment, mais, au vu de l’avancement des travaux du régulateur, la publication définitive de la loi devrait être en 2023, pour une entrée en vigueur en 2025 selon l’ACPR.

Règlement DORA : la résilience opérationnelle informatique sans frontières

Avec ce durcissement réglementaire se posent plusieurs questions : Comment se conformer à ce projet de loi, en tant qu’institution financière ? Aussi, quels sont les facteurs clés de succès pour la mise en œuvre de DORA par les services financiers ?

- Les acteurs du marché des Services Financiers face aux risques TIC

- La mise en conformité à la réglementation DORA : une stratégie en deux étapes clés

Les acteurs du marché des Services Financiers face aux risques TIC

Les risques informatiques et cyber sont multiples et vont en s’accroissant. Les établissements financiers n’ont pas à ce jour le même niveau d’appréhension et de gestion de ces risques.

Le Mood Meter des risques

Comprendre les principaux risques auxquels un acteur financier est exposé est capital pour pouvoir les anticiper et apprendre à les gérer (à travers des mesures de prévention, audit & contrôle, ou encore d’acceptation du risque).

La prise en considération des différents événements de portée internationale et disruptifs auxquels nous avons dû faire face ces dernières années est capitale pour appréhender la tendance qui s’observe depuis quelques années, et qui est confirmée par 77% des Responsables des Risques d’entreprises interrogés dans le cadre d’une étude sur la gestion des risques (Global Risk Management Study 2021 – In a World of Risk, Pace Comes From Preparation). Les risques identifiés sont de plus en plus complexes, interconnectés, et émergent de plus en plus vite.

Les tensions géopolitiques, les changements climatiques ainsi que les évolutions technologiques sont les facteurs initiaux qui ont par la suite été exacerbés par des événements tels que le télétravail, les pénuries de matières premières, le nombre d’attaques cyber en hausse … Sans surprise, ces événements mettent les risques opérationnels au cœur des préoccupations, et c’est d’ailleurs un point mis en exergue par cette étude : les risques opérationnels sont considérés comme ayant le plus augmenté ces dernières années, bien au-delà des risques Tiers, réglementaires …

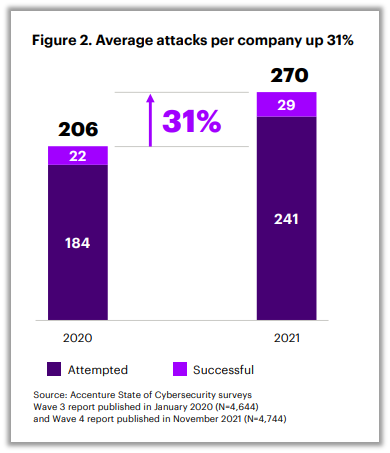

Cela se confirme concrètement par la tendance haussière du nombre de cyber-attaques entre 2020 et 2021 par exemple : selon une étude sur la cyber-résilience (State of Cybersecurity Report 2021 | 4th Annual Report), il était constaté en moyenne 270 attaques par entreprise en 2021, soit une augmentation de 31% par rapport à l’année précédente.

Avec l’avènement des nouvelles technologies, de plus en plus adoptées par les entreprises, les fonctions risques rencontrent des difficultés croissantes à évaluer et analyser les risques associés à cette disruption. Par conséquent, cette tendance haussière du nombre de cyber-attaques ne devrait malheureusement pas se tarir.

Où en sont les acteurs du marché des services financiers face à la montée des risques « cyber » ? Ont-ils la même maturité, et donc la même résilience, quant à la gestion des risques liés à l’adoption des nouvelles technologies, et, de façon plus générale, à la gestion des risques opérationnels IT ?

La maturité du secteur financier en matière de gestion des risques IT

Aujourd’hui, il semblerait que la maturité des acteurs du secteur financier soit assez disparate (si l’on met en perspective la maturité des acteurs du Tier 1 au regard d’acteurs de plus petite taille).

On peut cependant les classer dans quatre grandes catégories :

- Les « champions de la Cyber », qui arrivent à concilier une certaine résilience face aux risques TIC tout en étant alignés avec la stratégie business de leur groupe. Ces champions de la cyber-résilience performent a minima dans 3 des 4 critères qualifiant une entreprise de « cyber-résiliente » :

- Stopper les attaques cyber,

- Trouver les brèches de sécurité,

- Réparer ces violations de sécurité

- En réduire l’impact.

- Les « Risk Takers » : les entreprises qui acceptent le risque cyber, mais qui vont prioriser la croissance business, et donc moins investir dans leur cyber résilience.

- Les « Business Blockers », faisant passer la cybersécurité avant le business : cette stratégie peut être considérée comme un obstacle aux objectifs commerciaux d’une entreprise.

- Les « Vulnérables », qui ont un système de cybersécurité peu mature et sécurisent le minimum requis de leurs Systèmes d’Information.

Selon le profil, des métriques très différentes concernant le nombre d’attaques cyber et la capacité des entreprises à les contrer et en gérer les impacts sont constatées.

Selon la même étude sur la cyber-résilience, seulement 17% des attaques déboucheront sur une violation du Système d’Information (SI) pour un « Champion de la Cyber », tandis que plus d’une attaque sur deux causera une violation du SI pour un « Risk Taker » de la Cyber.

Contre toute attente, concernant les « Business Blockers », le taux de transformation du nombre d’attaque en violation concrète de leur SI est supérieur à celui des « Cyber Champion » (25% des attaques causeront des violations pour les « Business Blockers », contre 17% « Cyber Champion »).

Aligner les enjeux business avec ceux de la cybersécurité est donc capital pour être durablement cyber-résilient.

Mais alors qui sont ces Cyber Champions ? Existe-t-il une tendance sectorielle relative à ces « Maestro » de la cyber résilience ?

Selon les études précitées, le secteur le plus représenté parmi ces champions du risque TIC est celui de l’assurance à hauteur de 13%.

Pour autant, aucune autre tendance ne semble se dégager pour le moment : 42% des champions de la cyber se trouvent dans la catégorie « Autres », signifiant ainsi qu’ils appartiennent à un nombre tel de secteurs diversifiés qu’ils ne peuvent être quantifiés. Ainsi, le caractère disparate de la maturité du secteur financier se confirme.

A contrario, une tendance géographique semble se profiler : les Etats-Unis et le Japon semblent concentrer près de la moitié des Cyber Champions interrogés dans le cadre de l’étude réalisée.

Face à l’augmentation des risques opérationnels IT, et compte tenu de la disparité de maturité de chaque établissement en ce domaine, quelle stratégie mettre en œuvre pour parvenir à une mise en conformité aux exigences DORA ?

La mise en conformité à la réglementation DORA : une stratégie en deux étapes clés

Si le projet de règlement DORA ne consacre aucun nouveau principe, il créé une volonté de tendre vers une résilience opérationnelle, ayant pour objectif de maitriser durablement les risques cyber tant liés à son propre système d’information qu’à ceux des tiers liés.

Ainsi, se mettre en conformité avec cette réglementation suppose au préalable de bien connaître sa stratégie de gestion des risques puis de définir une feuille de route centrée sur 3 grands facteurs de succès.

Définir son ambition

Chaque entité financière doit comprendre et évaluer son exposition aux risques. Pour ce faire, plusieurs facteurs doivent être pris en compte :

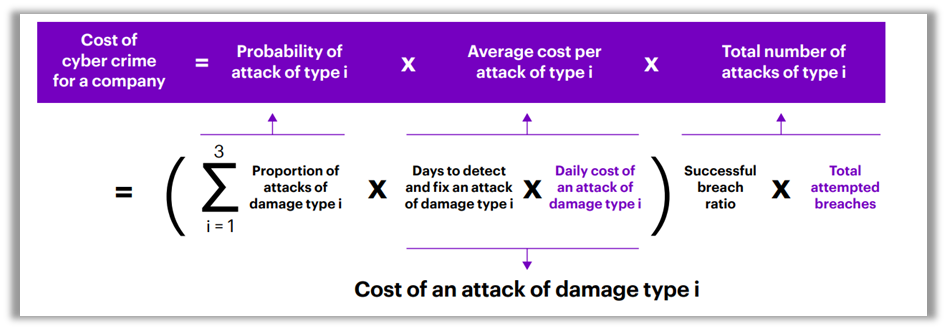

- le coût engendré par une attaque cyber : pour le calculer, la risk study précitée préconise de prendre en compte :

- la probabilité de l’attaque ;

- le coût moyen d’une attaque ; et,

- le nombre total d’attaques survenues (incluant les tentatives).

Cette analyse doit être réalisée par typologie d’attaque (phishing, déni de service (DOS), smurf …) et doit être décliné pour l’ensemble des sous-traitants de l’entité financière pour obtenir une vision à 360° de son exposition au risque.

- le risque de réputation: une attaque cyber peut affecter l’image de marque attachée à l’entité financière et avoir de lourdes conséquence dans le recrutement de nouveaux talents, sur la perte de croissance due à la désertification des clients ou sur la difficulté de faire perdurer et/ou accroître les partenariats.

- Les événements d’actualité: la mise en place (forcée et pas forcément anticipée) du télétravail depuis la crise sanitaire du Covid, la guerre en Ukraine … sont autant de bouleversements générateurs de risques importants. Leur soudaineté et leur nouveauté peuvent conduire à des attaques démultipliées contre des dispositifs non/insuffisamment résilients.

- Les évolutions réglementaires: les législateurs français et européens produisent des cadres réglementaires sans cesse mis à jour afin de répondre aux évolutions sociétales et ainsi encadrer les nouveaux risques au fur et à mesure de leurs apparitions.

Une fois cette évaluation d’exposition aux risques cyber réalisée, l’entité financière doit s’interroger sur son niveau de maturité :

- les modalités d’identification des tentatives d’attaques cyber doivent être prises en compte : Sont-elles automatisées via un outil ?

- les workflows relatifs à leur traitement doivent être décortiqués : ce process est-il automatisé ? Une équipe est-elle dédiée au traitement ? …

- l’efficience de la résolution des incidents doit être challengée : quel est le délai de traitement moyen ?

En tout état de cause, ce diagnostic est à réaliser en tenant compte des différentes évolutions réglementaires, actuelles et à venir, mais aussi au regard des meilleures pratiques de place.

Cette évaluation complète, incluant le diagnostic de l’existant, doit être présentée à l’organe décisionnel afin qu’il puisse arbitrer sur les optimisations et/ou développements à opérer dans le cadre de son dispositif de lutte contre les risques cyber, permettant ainsi d’acter l’ambition de résilience opérationnelle que poursuivra l’entité.

Définir une roadmap de mise en conformité

L’entité financière doit donc définir une roadmap afin de se mettre en conformité par rapport aux exigences de résilience opérationnelle portées par la réglementation DORA au regard des pratiques de place ou de celles de ses pairs (à taille et activités similaires) et de son niveau de maturité.

Pour être en mesure de définir cette roadmap correctement, il est impératif, de bien analyser et comprendre son existant, et cela à travers 3 grandes catégories :

- Les processus métiers,

- Les outils,

- L’humain.

Cette compréhension de la situation actuelle permettra de définir l’effort nécessaire pour atteindre le point cible, notamment sur les plans budgétaires, humains et planning.

Il est à noter que les banques dites systémiques, considérées comme des Opérateurs d’Importance Vitale (OIV) au sens de la Loi de Programmation Militaire, sont d’ores et déjà assujetties à des obligations de protection de leurs Système d’Information (similaire au projet de règlement DORA ) : porter les enjeux SI au plus haut niveau de l’entité, mise en place d’un système de journalisation pour chaque SIIV (Système d’information d’importance vitale), mise en place d’une organisation de gestion des incidents de sécurité informatique etc.

La définition et la mise en œuvre de ce point cible ne représentera pas les mêmes enjeux entre les entités financières déjà conformes à la Loi de Programmation Militaire et celles qui ne le sont pas.

Les processus métiers

Les processus métiers constituent les fondements de la gestion des risques : une mauvaise définition et/ou compréhension de ces derniers mettraient en échec les 2 autres aspects que sont les outils et l’humain.

En effet, l’outillage arrive en support des processus (à des fins d’optimisation des processus, de consolidation, de traçabilité des process …), et l’humain, quant à lui, va venir mettre en œuvre les processus définis.

La compréhension des processus métiers existants est donc primordiale.

Cette compréhension passe par l’analyse des politiques du groupe, des procédures déclinées selon les métiers (si nécessaire), et des modèles opérationnels cibles (ou « Target Operating Model », servant d’accompagnement opérationnel aux parties prenantes), en lien avec les processus clés relatifs à la gestion des risques TIC.

Une fois ces éléments analysés, comprendre le lien avec les outils existants (s’il y en a) et l’implication de l’humain dans le processus sera d’autant plus simple, permettant de localiser les lacunes par rapport à ce process : Est-ce le process lui-même ? Les outils associés sont-ils assez performants par rapport à l’ambition du process métier défini ? L’acculturation par rapport à la politique de cyber-résilience du Groupe a-t-elle été correctement faite ?

En mettant cette bonne compréhension des processus existants au regard de la cible, définie en fonction des ambitions et de la réglementation, il est possible de formaliser une analyse d’écart.

Ainsi, les plans d’actions vont naturellement découler de ces écarts et seront échelonnés dans le temps (selon la priorité des actions, les interdépendances associées …) afin de définir une roadmap.

Exemples de plans d’actions à anticiper dans le cadre du projet de loi DORA :

- Mise à jour de la politique de gestion des risques TIC,

- Mise à jour de la procédure de continuité d’activité, et des scénarios associés,

- Mise à jour des documents de reporting d’incidents …

L’outillage

Analyser l’outillage existant venant en support aux processus métiers définis est important pour :

- Confirmer l’alignement outils / process cible,

- Identifier les mises à jour et nouveaux besoins venant en soutien à ce process, toujours dans l’optique de définir des actions de transformation, à mettre en musique avec la roadmap des processus métiers.

Globalement, vis-à-vis du projet de loi DORA, les outils peuvent couvrir les besoins suivants (liste non-exhaustive) :

- Analyse des prestataires tiers et de leur politique de sécurité face aux menaces liées aux technologies de l’information et de la communication (TIC). Il existe pour cela des instruments d’évaluation et de gestion des risques cyber sur les tiers. Ces outils proposent des ratings/scorecards pour chaque tiers évalué, avec des plans d’actions associés si ces derniers ne correspondent pas aux attentes d’un point de vue cybersécurité.

- Gestion et reporting des incidents: certains outils peuvent aider à la centralisation et classification des incidents, permettant ainsi de constituer des KPIs (Key Performance Indicators) probants et d’identifier des « modèles » réguliers d’incidents cyber.

- Pilotage opérationnel de la gestion des risques cyber : certaines plateformes permettent d’élaborer et suivre des plans d’actions, de collaborer avec les différents contributeurs de ces plans d’actions, voire de proposer des tâches automatiques selon le risque cyber identifié.

- Communication avec les autorités: outil de reporting des éventuels incidents cyber, de façon complète et automatique.

Aussi, certains acteurs de la place proposent des solutions clés en main pour la couverture des risques cyber. Ils s’inscrivent également dans une démarche de gestion holistique des risques (solutions de gestion des risques intégrée (Integrated Risk Management solution – IRM), proposant à la fois des modules pouvant couvrir des exigences de gestion des risques TIC (« risques liés aux tiers » ou encore « IT security »)), mais aussi des risques liés aux données personnelles ou à l’environnement.

Cette approche capitalise sur les données provenant des différents modules afin d’évaluer l’ensemble des risques de l’entreprise, ce qui est un avantage considérable.

L’humain

Le renforcement de la culture du risque relative aux technologies de l’information et de la communication (TIC) doit être assuré au sein de chaque institution financière, auprès de l’ensemble des collaborateurs, incluant l’organe de direction.

Ce renforcement s’inscrit dans un objectif plus global qu’est la mise en œuvre d’une résilience opérationnelle numérique.

Pour ce faire, les entités financières sont invitées à :

- allouer un budget global suffisant à la mise en œuvre d’un dispositif de prévention des risques TIC, basé notamment sur la formation et la diffusion d’une culture du risque au sein de l’institution.

Ce dispositif, pour être performant, doit permettre de former et sensibiliser l’ensemble des collaborateurs de l’institution (incluant les organes de direction) et doit être adapté aux spécificités et besoins propres à chaque métier, ainsi qu’au niveau de connaissance et de sensibilisation des collaborateurs.

Les institutions financières doivent donc être en mesure de proposer une palette de dispositifs (e-learning, formations en présentiels, diffusion de campagnes d’emails…) visant à assurer cette montée en compétence ainsi qu’un calendrier de mise en œuvre, permettant de s’inscrire dans le processus afin de le pérenniser.

- impliquer activement toutes les strates de management sur la gestion des risques TIC, incluant les organes de direction.

Le projet de règlement DORA prévoit, en effet, que les membres de l’encadrement supérieur responsables des TIC rendent compte, au moins une fois par an, des tests de résilience et des incidents liés à l’informatique et formulent des recommandations auprès de la direction. Les institutions doivent donc veiller à ce que les organes de direction jouent un rôle actif dans l’encadrement des risques TIC. Ces derniers doivent être nativement intégrés dans la définition des stratégies conduites par les entités financières. Des impacts sur le modèle organisationnel sont nécessairement à prévoir. Ceci peut être également l’occasion d’optimiser les process existants et de définir de nouveaux RACI (Responsible, Accountable, Consulted, Informed) permettant une pérennisation de cette implication des organisations de direction dans la gestion des risques.

- identifier une équipe, interne ou externe, qui aura la charge de réaliser des tests de pénétration. Si le choix de l’institution se porte sur le détachement d’une équipe interne, il est à rappeler que celle-ci doit demeurer parfaitement indépendante. Ce point doit être matérialisé au sein de l’organisation de l’institution (via des process, RACI …) afin que les résultats des tests de pénétration puissent être utilisés dans les analyses.

En conclusion, et compte tenu des orientations décrites dans le projet de règlement DORA, les entités financières pourraient d’ores et déjà réfléchir à la mise en œuvre de 2 actions principales :

- Évaluation de l’existant: cette évaluation doit être à 360°, permettant tant d’identifier le niveau de maturité et de résilience des process et outil existants, que le dimensionnement des équipes dédiées à la gestion des risques. Ce travail d’introspection complet permet ainsi d’identifier les zones de risques du dispositif mais également de mettre en exergue les points forts, rendant l’exercice de priorisation des actions d’amélioration à conduire plus efficient. Par ailleurs, il permet d’apporter une meilleure visibilité aux membres de la direction et de défendre plus facilement les positions à adopter.

- Définition d’une trajectoire d’amélioration du dispositif de gestion des risques cyber et des moyens visés pour sa mise en œuvre afin de tendre vers une résilience opérationnelle: une fois l’analyse de l’existant opérée et l’ambition de l’entreprise définie, une trajectoire doit être arrêtée, en lien avec les membres de la direction, qui devront être impliqués tant pour sa définition que pour sa mise en pratique. Il est important d’inclure nativement cette stratégie au cœur du fonctionnement de l’entité financière.

Pour ce faire, des objectifs d’amélioration du dispositif de gestion des risques cyber doivent être clairement identifiés et classifiés selon leur périmètre (process, outils et humain …), afin d’assurer une mise en œuvre pragmatique et efficiente au sein de l’entité et une remontée des KPI fluidifiée, facilitant ainsi le suivi de l’implémentation des différentes actions attendues. Par ailleurs, les membres de la direction doivent également définir les moyens financiers et humains auxquels ils souhaitent recourir pour mettre en œuvre cette trajectoire.

Auteur

Pauline Langlès ![]() , Fanny Genevrey

, Fanny Genevrey ![]() , Stéphane Nguyen-Huu

, Stéphane Nguyen-Huu ![]()

Pauline Langlès – Consultante senior, Diplômée du Cycle Expert Conformité de l’ESBanque

Fanny Genevrey – Consultante senior – Finance & Risk & Compliance

Stéphane Nguyen-Huu – Manager Strategy & Consulting – Finance & Risk & Compliance

Proposition de RÈGLEMENT DU PARLEMENT EUROPÉEN ET DU CONSEIL sur la résilience opérationnelle numérique du secteur financier et modifiant les règlements (CE) nº 1060/2009, (UE) nº 648/2012, (UE) nº 600/2014 et (UE) nº 909/2014